OpenAI presentó recientemente una herramienta de IA para generar videos llamada “Sora” para usuarios de ChatGPT Plus y Pro. Pero esta no es la primera herramienta de este tipo. De hecho, hoy en día existen muchos servicios que permiten crear vídeos basados en inteligencia artificial de forma extremadamente rápida. Se están convirtiendo poco a poco en un potente asistente para los creadores, pero a veces resultan confusos para los espectadores porque suele ser difícil determinar qué vídeos son reales o qué clips son creados por IA.

A medida que el mercado de creación de videos con IA crece rápidamente día a día, detectar videos falsos o generados por IA en línea se vuelve cada vez más difícil. Para ayudar a solucionar este problema, Meta ha presentado una herramienta de marca de agua llamada “Meta Video Seal”, que funciona agregando una marca de agua al contenido de video generado por IA.

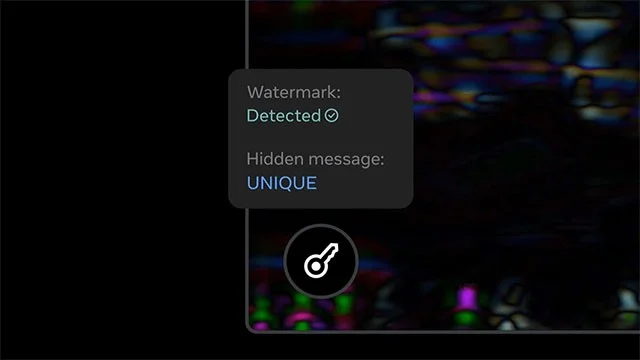

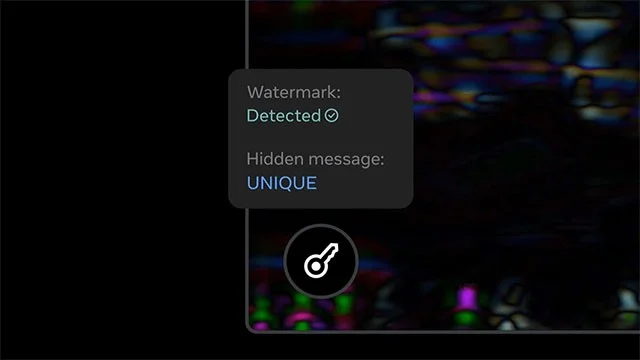

Según Meta, agregar marcas de agua a los videos generados por IA no tendrá mucho impacto en la experiencia del usuario. Las marcas de agua también se pueden incrustar directamente sin afectar el aspecto general del vídeo. Además, Video Seal también puede agregar mensajes ocultos a los videos, que luego pueden detectarse para rastrear el origen del video.

La característica especial de "Meta Video Seal" es su capacidad de "resistir" los esfuerzos comunes de edición de video, incluidos los algoritmos de desenfoque, recorte o compresión para compartir en línea más fácilmente. Esto significa que si alguien edita un video que contiene una marca de agua utilizando Meta Video Seal, la marca de agua permanecerá intacta, lo que ayudará a verificar la autenticidad y el origen del video.

Meta está implementando la herramienta bajo una licencia autorizada, junto con documentación de capacitación y código de inferencia. También hay una demostración interactiva para que cualquiera pueda probar el modelo.

“Si bien las herramientas de IA pueden ayudar a unir al mundo, es importante que implementemos salvaguardas para mitigar el riesgo de imitación, manipulación y otras formas de mal uso que podrían socavar sus beneficios”, dijo Meta. “La incorporación de marcas de agua en los videos generados por IA es un paso importante hacia una mejor trazabilidad del contenido y los modelos de IA”.

Con Video Seal, Meta pretende dificultar que actores maliciosos exploten la IA para difundir noticias falsas. Si bien la IA puede hacer cosas increíbles y hacer que el contenido útil sea más accesible, también existen ciertas barreras que deben existir para garantizar que haya información precisa disponible para todos.