Google acaba de anunciar planes para que su modelo de inteligencia artificial más avanzado (Gemini versión 2.5 Pro) esté disponible de forma gratuita para todos los usuarios de la aplicación Gemini. Este piloto, que anteriormente solo estaba disponible para los suscriptores pagos de Gemini Advanced, ahora se está implementando para el público de forma gratuita a partir de hoy.

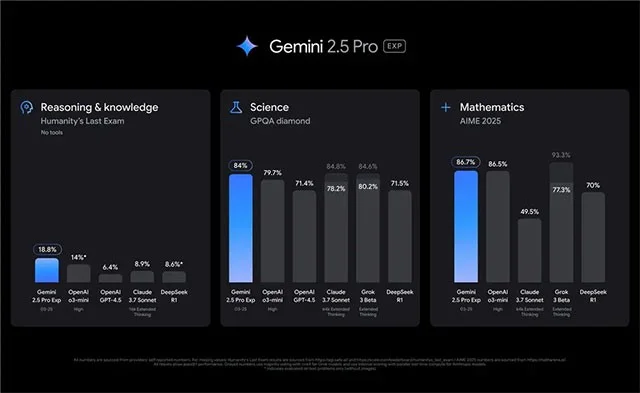

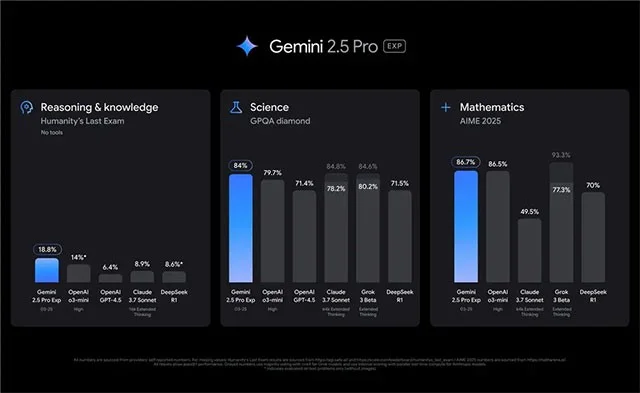

Google lanzó el Gemini 2.5 Pro a principios de esta semana como el "modelo de IA más inteligente" de la compañía hasta la fecha, con capacidades de pensamiento más complejas que las versiones anteriores. Este modelo actualizado admite una variedad de funciones, incluida la integración de aplicaciones y navegadores, cargas de archivos y el trabajo con la herramienta de colaboración Canvas de Google.

Inicialmente, el acceso a Gemini 2.5 Pro está limitado únicamente a los usuarios de Gemini Advanced: la tarifa de suscripción es de $19,99 por mes en los EE. UU. Pero ahora Google ha abierto esa versión beta a todos los usuarios de Gemini, una medida que, según la compañía, tiene como objetivo "poner nuestro modelo más inteligente en manos de la mayor cantidad de personas posible lo antes posible".

El nuevo modelo Gemini 2.5 Pro ya está disponible en el sitio web de Gemini y se implementará en las aplicaciones móviles de Android e iOS en los próximos días. Las recientes actualizaciones de la aplicación también han mejorado la experiencia del usuario al facilitar la selección y el recuerdo del modelo Gemini que se está utilizando.

Este modelo, actualmente en versión beta, admite funciones como integración de aplicaciones y extensiones, cargas de archivos y funciones de Canvas. Según la información referenciada en el anuncio, el Gemini 2.5 Pro (prueba) lidera actualmente el ranking LMArena. Google también señala que está trabajando para mejorar la programabilidad del modelo. Gemini 2.5 Pro también tiene una ventana de contexto de hasta 1 millón de tokens, lo que permite que el modelo maneje grandes conjuntos de datos y mantenga el contexto durante interacciones largas. La compañía planea ampliar este límite a 2 millones de tokens en el futuro.